Universitat Oberta de Catalunya

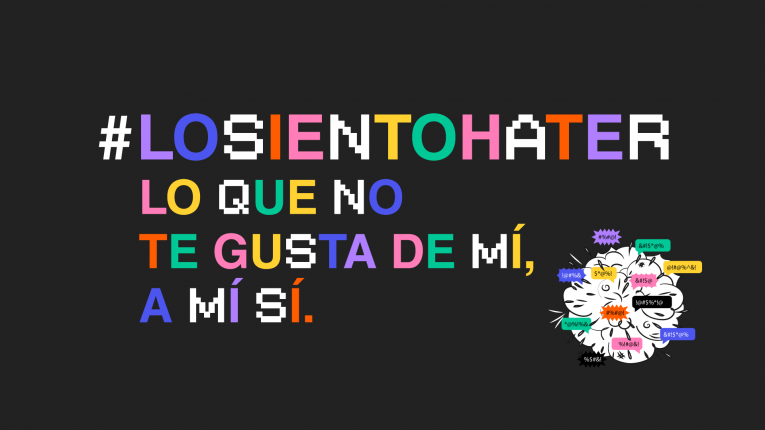

- 18 de junio – Día internacional para contrarrestar el discurso de odio

Los algoritmos “premian” a los contenidos que generan más interacciones: de ahí que los discursos de odio sean especialmente virales

Evitar la interacción con estos perfiles, formar a los más jóvenes en el uso de las redes sociales, conocer las consecuencias y denunciar son medidas útiles

Laila A. Wahedi y Daniel Robert Thomas, investigadores de Meta (empresa matriz de Facebook, WhatsApp e Instagram), han llevado a cabo un reciente estudio, que se ha publicado en la revista científica PNAS. El estudio, Disrupting hate: The effect of deplatforming hate organizations on their online audience, clarifica algo que ya apuntaban investigaciones anteriores: expulsar de las redes a los llamados líderes tóxicos es eficaz para disminuir la difusión de discursos de odio.

El personal investigador identificó a los perfiles más activos dentro de seis comunidades que movían a 26.000 usuarios de redes. Dichos perfiles (estos líderes tóxicos) fueron expulsados de las comunidades. Wahedi y Thomas encontraron tres conclusiones “destacables”: una, que tras la expulsión los usuarios veían, de promedio, casi la mitad de contenido de odio por día que antes de la expulsión; dos, que el subgrupo menos afín a estos líderes tóxicos pasó enseguida a recibir contenido más saludable y a consumir menos odio, mientras que los más implicados reaccionaron negativamente y aumentaron este consumo negativo a corto plazo, pero empezó a decaer en solo dos meses. La tercera conclusión es que, de promedio, los usuarios redujeron su consumo total de contenido (en torno a un 10 %).

Si, como concluye el estudio, queda demostrada la eficacia de la expulsión de estos perfiles para limitar el discurso de odio, ¿es el camino para acabar con él? “Debemos defender la libertad de expresión siempre y cuando no atente contra la dignidad de nadie”, explicaba Dolors Reig, profesora colaboradora de los Estudios de Ciencias de la Información y de la Comunicación de la Universitat Oberta de Catalunya (UOC). El cambio de paradigma comunicativo que han supuesto las redes sociales “nos ha convertido a todos en micromedios” que nos facultan para trasladar nuestro mensaje a las multitudes. “Las redes sociales son una herramienta potentísima para el cambio social, pero también lo son para la difusión de discursos de odio”, añade.

La pandemia como impulsora de los discursos de odio

¿Cuándo han arreciado este tipo de mensajes en las redes sociales? El secretario general de las Naciones Unidas, António Guterres, le puso fecha al estallido del discurso de odio: la pandemia de la COVID-19. Así lo reflejaba en una carta de 2020, donde hacía un llamamiento a todos los agentes sociales y políticos para detener esta “oleada de odio y xenofobia”. “El sentimiento antiextranjero ha aumentado en internet y en las calles”, decía. En aquel momento, la gente empleó las redes sociales “de forma intensiva para informarse y relacionarse, una conducta que se vio potenciada por el propio confinamiento: las plataformas sociales se presentaban como ventanas de conexión con el mundo exterior”, comenta Silvia Martínez, directora del máster universitario de Social Media: Gestión y Estrategia de la UOC, profesora de los Estudios de Ciencias de la Información y de la Comunicación de la UOC e investigadora del grupo GAME. A la vez, “las emociones que se experimentaron durante aquel periodo excepcional incrementaron también la crispación: había miedo, tensión, preocupación por la situación sanitaria, un contexto económico de incertidumbre…”.

Si la pandemia es un punto de inflexión a partir del cual este tipo de mensajes calan y se difunden más, los motivos que los hacen proliferar son variados. Por una parte, están los de tipo psicosocial, hacia los que apunta Dolors Reig: la presencia de “comunidades que fomentan y aplauden estos discursos” es uno ellos (como aquellas sobre las que han actuado Wahedi y Thomas). Otros son el anonimato y la distancia emocional que implica no interactuar cara a cara, la evasión de la responsabilidad “por percibir que se actúa en un espacio virtual que genera la sensación de que el contexto no es real”, y el efecto espiral hacia la transgresión. La saturación de mensajes en las redes hace que “uno necesite ser cada vez más transgresor para generar la misma atención”, explica la profesora, que incide en el uso de esta espiral que hacen a menudo los propios políticos: “Muchos políticos han jugado a esto: a decir la barbaridad más burda para conseguir la popularidad”, comenta la experta.

Silvia Martínez, por su parte, habla de dinámicas de funcionamiento y conversación de ciertas redes sociales como palanca que mueve estos mensajes. “La inmediatez y el mensaje breve favorecen la difusión de contenidos más viscerales que racionales y argumentados. La reflexión y el análisis ceden terreno frente a la reacción automática”. También añade otro factor que interviene en la proliferación: las interacciones, la viralidad. “Los algoritmos suelen potenciar y dar más visibilidad a esos contenidos que acumulan interacciones, y el discurso del odio suele generar precisamente un aumento de las reacciones”. Reig suma a estas causas la proliferación de partidos de ultraderecha en todo el mundo y la circulación de información “distorsionada o directamente falsa” que se propaga en estas plataformas. “Las redes sociales se han vuelto instrumentos de propaganda”, afirma.

Perfil de la víctima del discurso de odio: ideología distinta, origen distinto y orientación sexual o identidad de género distintas

¿Qué colectivos reciben más odio? Un estudio regional publicado en agosto de 2020 por la Asociación Civil Comunicación para la Igualdad de Argentina y Sentiido de Colombia con el apoyo de la Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura (UNESCO), en el cual se analizaron datos sobre violencia digital en Argentina, Colombia, Nicaragua, México, Paraguay, Uruguay y Venezuela, encontró evidencia a nivel regional de ataques coordinados y troleo de género contra mujeres, e identificó que cuando éstas expresan sus opiniones políticas en los espacios digitales son atacadas no por sus ideas sino por el hecho de que son mujeres expresándolas públicamente.

Las mujeres que utilizan las redes sociales para expresarse en favor de la igualdad de género, los derechos humanos de las mujeres y derechos de minorías son blanco de actos de ciberacoso. También se identificó un ataque desproporcionado a través de campañas digitales de desprestigio hacia mujeres parlamentarias o políticas, periodistas y, en general, mujeres activas en el debate digital, el objetivo de dicho ataque, es silenciarlas y dejar entrever los fuertes rasgos patriarcales de las sociedades latinoamericanas.

Con respecto al racismo y la xenofobia, el Observatorio Español contra el Racismo y la Xenofobia (OBERAXE) monitoriza a diario el discurso de odio en las redes sociales y notifica en las mismas los contenidos constitutivos de delito. En su último boletín de monitorización (marzo-abril de 2023) indica que las redes han retirado el 55 % de los contenidos denunciados. Los discursos de odio hacia las personas norteafricanas y la islamofobia copan el 60 % de estos contenidos.

El mencionado OBERAXE, en su memorándum explicativo, enumera los rasgos en los que incide el discurso del odio en su recomendación de política general n.º 15: racismo, discriminación racial, discriminación basada en el género, sexismo, homofobia, transfobia, xenofobia, antisemitismo, islamofobia y discriminación contra las personas gitanas, además de varios delitos que incluyen el genocidio o la trivialización de este tipo de delitos.

Aprender a combatir los discursos de odio en las redes

El estudio presentado por Laila A. Wahedi y Daniel Robert Thomas abre una puerta a los responsables de las redes sociales para tomar medidas al respecto, pero ¿qué otras medidas pueden implementarse para reducir y combatir el discurso de odio? “Idealmente, las medidas deberían focalizarse en que no se produjera ese discurso”, explica Martínez, “pero, una vez iniciado, lo fundamental es no alimentarlo al comentarlo o compartirlo, pues esto es un modo de reacción y, como señalaba antes, los algoritmos suelen dar más visibilidad a los contenidos que generan interacciones”. Además, esa mayor visibilidad hace “más fácil que se produzcan nuevas reacciones, que normalmente suelen ser viscerales y con mensajes cada vez más polarizados”. Para Dolors Reig, es vital formar en el uso de las redes e informar: “A mi alumnado le digo, por ejemplo, cuando surge un vídeo de abusos que atenta contra la dignidad de las personas, que ni lo busquen ni lo visualicen, porque al final los algoritmos de las redes sociales funcionan por popularidad”.

Finalmente, denunciar es otra opción para frenar estos perfiles tóxicos. “El usuario debe conocer las opciones y vías para denunciar esos contenidos y ponerlos en conocimiento de las propias plataformas, que pueden intervenir eliminando contenidos y suspendiendo perfiles e, incluso, en caso de que haya podido incurrirse en un delito de odio, ponerlo en conocimiento de la policía o la guardia civil”, incide Martínez. Frenarlos evita consecuencias peores: “Esto es el posdigitalismo”, explica Dolors Reig. “Estamos en una sociedad en la que lo digital influye en lo real. Los mensajes de odio llevan a la gente a suicidarse”.

You may also like

-

Masacre en Tehuitzingo… cuando la percepción desbarata la realidad

-

Repartir apoyos no garantiza votos

-

Puebla 2027: Entre alianzas, traiciones y ambiciones

-

“Aventuras Yu y Ro”: los colombianos que están convirtiendo el Mundial 2026 en una guía de viajes para millones de latinos

-

Alejandro Armenta: Un desarrollo económico aglutinador, sectorial, global y regional